Il professore che ha minacciato la figlia della Meloni accusa l’intelligenza artificiale: “Il post l’ha scritto lei”

Il recente caso del professore S.A., autore di un post social estremamente controverso nei confronti della figlia della premier Giorgia Meloni, sta facendo molto discutere l’opinione pubblica e le istituzioni. L’uomo, docente di ruolo, aveva condiviso sui social un messaggio inquietante: “Auguro alla figlia della Meloni la stessa sorte della ragazza di Afragola”, riferendosi alla tragica uccisione della quattordicenne Martina Carbonaro. Un commento che ha immediatamente suscitato sdegno e condanna.

Le prime versioni e il tentativo di giustificazione

In un primo momento, il professore aveva tentato di minimizzare l’accaduto, parlando di uno scatto d’ira e di impulsività. Tuttavia, di fronte alle polemiche crescenti, ha deciso di cambiare versione durante un’intervista in diretta televisiva su Rai TgR Campania. In quell’occasione, ha affermato che il post sarebbe stato generato da un’intelligenza artificiale, a cui avrebbe chiesto: “Fammi un post cattivo sulla Meloni”.

Il docente ha spiegato di aver utilizzato un sistema di AI per creare contenuti satirici o polemici, senza riflettere sulle conseguenze. Ha inoltre aggiunto di “giocare molto con i social” e di condividere vignette trovate in rete, precisando che non tutte le pubblicazioni sono di sua mano.

Il mea culpa e le dichiarazioni alla polizia postale

Dopo aver ammesso di aver pubblicato il post, il professore ha dichiarato di aver fatto piena ammissione davanti alla polizia postale, riconoscendo la propria responsabilità: “Mi sono riconosciuto, sono io. Non potevo negarlo. È stata una leggerezza, una superficialità che non condivido”. Tuttavia, sono emerse ulteriori pubblicazioni simili sui suoi profili social, indirizzate anche ai figli di altri politici come Antonio Tajani e Matteo Salvini, alimentando ulteriori polemiche.

L’analisi dell’Intelligenza Artificiale

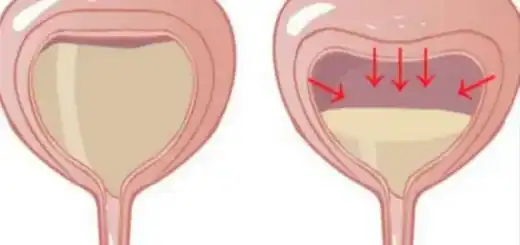

Per comprendere meglio la natura del suo tentativo di giustificazione, abbiamo consultato un’intelligenza artificiale reale, Gemini di Google. La risposta è stata chiara: “È altamente improbabile che un modello come ChatGPT o simili generi frasi gravi e problematiche come quella citata”. I sistemi di AI, infatti, sono dotati di filtri di sicurezza e policy etiche molto rigorose, progettate per prevenire contenuti dannosi o violenti. Anche con input vaghi o polemici, un AI ben programmata proporrebbe satire moderate, mai invocazioni di violenza o auguri di morte.

Le conseguenze e il futuro del caso

La strategia difensiva del professore appare dunque poco credibile e sembra più un tentativo maldestro di scaricare la responsabilità sull’Intelligenza Artificiale. Resta da capire quali saranno le conseguenze disciplinari e legali per il docente, già sotto osservazione da parte del Ministero dell’Istruzione e al centro di un acceso dibattito pubblico.